To jest druga część przewodnika "Mapa drogowa odpowiedzialnej sztucznej inteligencji dla organizacji społeczeństwa obywatelskiego". Aby dowiedzieć się więcej, przeczytaj artykuł "Od napięcia do zasady: Jak organizacje społeczeństwa obywatelskiego mogą przewodzić w dziedzinie odpowiedzialnej sztucznej inteligencji?", wprowadzenie do przewodnika (z kalendarzem publikacji dla każdej z części) oraz Część 1: PATRZ - Przygotowanie gruntu.

W Części 2: TWÓRZ, przygotuj się na zidentyfikowanie najważniejszych zasad swojej organizacji i nauczysz się je definiować.

2.1 Podejście polegające na wyszukiwaniu podstawowych wartości

Poniższe ramy zaadaptowano z książki Olivii Gambelin Responsible AI , która oferuje organizacjom praktyczną metodę identyfikacji wartości dostosowanych w wymiarze regulacyjnym, ekosystemowym i organizacyjnym.

→ Do pracy w tej sesji użyj arkusza Zidentyfikuj | Arkusz roboczy definiowania zasad AI. Zawiera on tabelę oceny dostrojenia wraz z wszystkimi dodatkowymi odniesieniami.

Przygotowanie podstaw:

Jeżeli podczas wywiadów przed sesją zebrałeś występujące napięcia, zacznij od przedstawienia grupie zsyntetyzowanych spostrzeżeń. Podziel się schematami, które usłyszałeś: nadziejami, obawami i kwestiami niepodlegającymi negocjacji. Daj grupie czas na reakcję i uzupełnienie tego, co zostało uchwycone.

Jeśli zdecydowałeś się na ujawnienie napięć na żywo podczas sesji, zacznij od 5 pytań. Przeznacz 5 minut na indywidualne przemyślenia, a następnie 15-20 minut na podzielenie się nimi w grupie. Zapisz wszystko na tablicy lub we współdzielonym dokumencie.

Po ujawnieniu napięć, twój zespół posiada:

Spostrzeżenia z wywiadów lub przemyśleń (dotyczące tego, co chcesz chronić)

Rejestr AI pokazujący wykorzystywane narzędzia i istniejące obawy.

Aktualną wiedzę: wartości twojej organizacji, stosowne regulacje i wzorce z branży

Teraz należy to połączyć, aby zidentyfikować zasady o największym znaczeniu.

Tworzenie listy zasad:

Zacznij od zebrania wszystkich zasad zgromadzonych podczas fazy PATRZ:

Powszechne dotyczące zasady odpowiedzialnej AI pochodzące z ram i badań porównawczych (6-12 najczęściej cytowanych)

Wartości i zasady istniejące w twojej organizacji

Wszelkie zasady, które pojawiły się podczas rozmów o napięciach (np. jeżeli wielokrotne pojawienie się "autentyczności", może wskazywać na zasadę "Człowiek w centrum").

Zasady wynikające z twojego otoczenia regulacyjnego

Prawdopodobnie będziesz mieć aż 12-20 potencjalnych zasad. Nie szkodzi. Następny krok pomoże ci uporządkować je pod względem ważności.

Ocena dostrojenia:

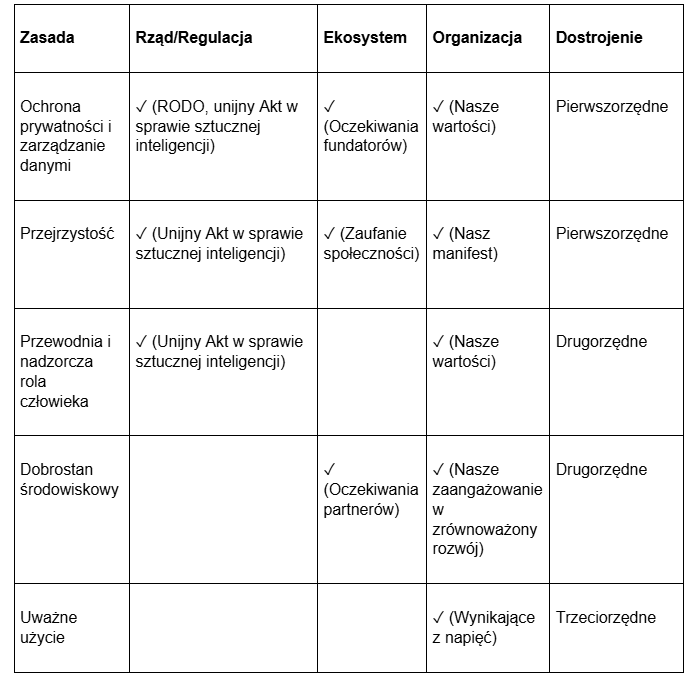

Oceń każdą zasadę pod względem jej istotności w trzech wymiarach:

(Przykładowy projekt)

→ Zidentyfikuj | Arkusz roboczy definiowania zasad AI zawiera powyższą tabelę gotową do wypełnienia, wraz z odniesieniem do unijnego Aktu w sprawie sztucznej inteligencji i informacjami o dostosowaniu, które pomogą ci w wypełnieniu kolumny Rząd/Regulacje.

Jaki wkład mają informacje zebrane podczas fazy PATRZ:

Kolumna Rząd/Regulacje: Badanie twojego otoczenia regulacyjnego powie ci, które zasady są prawnie wymagane lub zalecane.

Kolumna Ekosystem: Zrozumienie oczekiwań fundatorów, partnerów i społeczności powie ci, które zasady są ważne dla interesariuszy.

Kolumna Organizacja: Twoje istniejące wartości ORAZ spostrzeżenia dotyczące napięć powiedzą ci, które zasady są kluczowe dla tego, co robisz.

Rozmowa na temat napięć jest tutaj szczególnie cenna. Wyrażenie przez twój zespół dużych obaw związanych z autentycznością, wskazuje na takie zasady jak "Człowiek w centrum". Jeżeli w rejestrze powtarzają się odniesienia do ochrony prywatności danych, oznacza to, że pierwszorzędne znaczenie ma "Ochrona prywatności i zarządzanie danymi".

Punktowa ocena dostrojenia:

Pierwszorzędna (zaznaczone trzykrotnie): Zasada pojawia się we wszystkich trzech źródłach. Jest to zasada podstawowa, niepodlegająca negocjacjom.

Drugorzędna (zaznaczone dwukrotnie): Zasada pojawia się w dwóch źródłach. Ważna zasada, wspiera podejmowanie decyzji w przypadku konfliktu między zasadami pierwszorzędnymi.

Trzeciorzędna (zaznaczone jednokrotnie): Zasada pojawia się tylko w jednym źródle. Zasada może być ważne dla twojej organizacji, nawet jeżeli nie została podkreślona w innym miejscu.

Niech twoim celem będzie 3-7 pierwszorzędnych zasad. Większa liczba jest niewygodna, mniejsza może nie obejmować ważnych wymiarów. Skupiasz sie na szczegółowej definicji tych pierwszorzędnych zasad.

2.2 Od identyfikacji do definicji

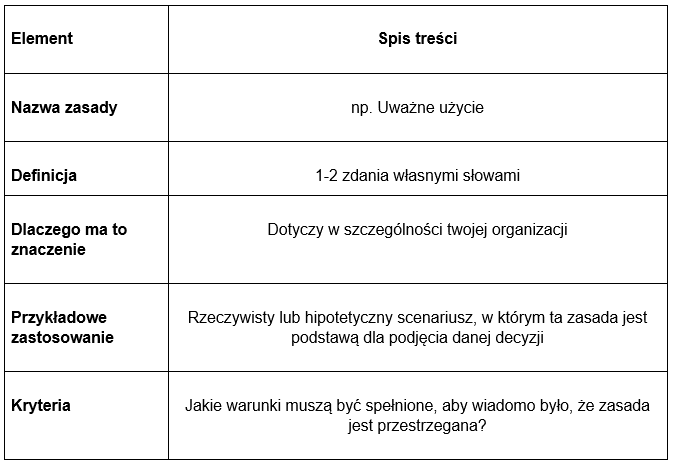

Zidentyfikowanie zasad to tylko połowa pracy. Takie takie jak "sprawiedliwość" czy "przejrzystość" oznaczają różne rzeczy dla różnych organizacji. Twoim zadaniem jest zdefiniowanie, co każda zasada oznacza w twoim kontekście.

→ Zidentyfikuj | Arkusz roboczy definiowania zasad AI zawiera Szablon definicji dla każdej zasady. Użyj go, aby uchwycić odpowiedzi zespołu na poniższe pytania.

Sformułowanie pytań:

Dla każdej zasady zidentyfikowanej jako pierwszorzędna (i ewentualnie drugorzędna), przeanalizuj w zespole poniższe pytania:

Co ta zasada oznacza dla naszej organizacji w kontekście AI? W jaki sposób łączy się ona z naszą misją, wartościami i konkretną pracą, którą wykonujemy? Co sprawia, że nasza interpretacja jest wyjątkowa?

Dlaczego ta zasada jest dla nas ważna? Jakie są potencjalne korzyści z jej przestrzegania? Jakie ryzyko lub negatywne konsekwencje przyniesie jej nieprzestrzeganie?

Czy możesz podać konkretny przykład, w którym ta zasada miałaby krytyczne znaczenie lub zostałaby zakwestionowana? Osadź ją w swojej rzeczywistej pracy. Prawdziwy scenariusz lub realna, hipotetyczna sytuacja.

Jakie kryteria pomogłyby nam ocenić, czy przestrzegamy tej zasady? Jakie warunki muszą zostać spełnione?

Studium przypadku: Khan Academy

Khan Academy przyjęła zasadę "Osiąganie celów edukacyjnych", ale nie poprzestała tylko na samej nazwie. Zdefiniowali kryteria, które wyjaśniają, czego wymaga przestrzeganie tej zasady:

"Istnieje wyraźny cel edukacyjny, który można osiągnąć dzięki wykorzystaniu sztucznej inteligencji".

"Istnieje plan monitorowania i oceny w celu określenia skutków"

"Istnieją mechanizmy zapobiegające wykorzystaniu AI w celach innych niż edukacja"

Zauważ, że nie są to jeszcze szczegółowe reguły wdrożeniowe, ale kryteria na poziomie zasad. Określają one, czego wymaga zasada, nie precyzując dokładnie, jak to osiągnąć. Ta szczegółowość przychodzi później, gdy opracowujesz politykę (więcej na ten temat tutaj) i przeprowadzasz oceny ryzyka (więcej na ten temat tutaj).

Wartość definiowania zasad na tym poziomie: zespół może teraz zapytać: "Czy zaproponowana przez nas funkcja AI ma wyraźny cel edukacyjny? Czy mamy plan pomiaru skutków? Jakie mechanizmy mogłyby zapobiegać nadużyciom?" Zasada dostarcza pytań, natomiast polityka i analiza ryzyka dostarczają odpowiedzi.

Studium przypadku: ChangemakerXchange

CXC zdefiniowało zasadę "Uważne użycie" przy pomocy konkretnych pytań zadawanych przez swój zespół zadaje przed każdym użyciem AI:

"Czy do realizacji tego zadania naprawdę potrzeba sztucznej inteligencji?"

"Czy jest to naprawdę zgrane z naszymi wartościami?".

"Co tracę, gdy używam tego narzędzia do realizacji tego zadania?".

Określili również, jak to wygląda w praktyce: "Niektóre zadania wymagają naszej pełnej obecności i troski, na przykład napisanie serdecznej wiadomości do członków, opracowanie teorii zmian lub przygotowanie sesji na jedno z naszych spotkań. Nadmierne delegowanie takich rzeczy do sztucznej inteligencji pociąga za sobą ryzyko utraty głębi, autentyczności lub znaczenia".

Zasada staje się wykonalna, ponieważ została zdefiniowana w kategoriach ich konkretnej pracy.

Rezultat: → Użyj arkusza Definiowanie zasad odpowiedzialnej AI znajdującego się w Zidentyfikuj | Arkusz roboczy definiowania zasad AI, aby wychwycić ten rezultat dla poszczególnych zasad.

Te definicje stają się podstawą twoich struktur i polityk zarządzania.

2.3 Znaczenie różnorodnych głosów

To, kto uczestniczy w tym procesie, jest równie ważne jak sam proces.

Dlaczego różnorodność ma znaczenie:

Ludzie będący najbliżej realizowanej przez ciebie misji dostrzegają zagrożenia, które umykają kierownictwu

Pracownicy pierwszej linii rozumieją, w jaki sposób sztuczna inteligencja wpływa na codzienną pracę

Członkowie społeczności mogą mówić o skutkach, które wewnętrzne zespoły mogą przeoczyć

Zróżnicowanie perspektyw zapobiega martwym punktom i myśleniu grupowemu

Kiedy ludzie uczestniczą w tworzeniu zasad, stają się strażnikami tych wartości

Kto powinien znaleźć się w pokoju:

Kierownictwo (dla pokazania akceptacji i upoważnienia do zaangażowania)

Personel programowy/operacyjny (realia praktycznego działania)

Personel techniczny, jeżeli go posiadasz (dla przemyśleń o wykonalności)

Personel ds. komunikacji/relacji zewnętrznych (dla pokazania perspektywy interesariuszy)

Pracownicy administracyjni (często pierwsi użytkownicy AI w zakresie narzędzi zwiększających wydajność)

W miarę możliwości: członkowie społeczności, beneficjenci lub partnerzy

Manifest CXC wyłonił się z głębokiego wsłuchania się w głos całego zespołu. Ramy Khan Academy są utrzymywane przez wielofunkcyjną grupę roboczą obejmującą zespoły ds. produktów, danych i badań użytkowników, co gwarantuje, że ich podejście jest kształtowane przez różne perspektywy.

Wskazówki ułatwiające:

Stwórz warunki bezpieczeństwa psychologicznego: bez osądzania, bez "złych" odpowiedzi

Korzystaj z czasu na indywidualne przemyślenia zanim przejdziesz do dyskusji w grupie (zapobiega to sterowaniu dyskusją przez dominujące głosy)

Wyraźnie zaproś cichszych uczestników do udziału w rozmowie

Dokumentuj odmiennych poglądów, a nie tylko konsensus

Rozważ skorzystanie z mechanizmów anonimowego zgłaszania informacji w przypadku delikatnych kwestii

Wyraźnie powiedz, że brak zgody jest informacją, a nie porażką

Unikanie "teatru korporacyjnego":

Celem nie jest stworzenie wycyzelowanego dokumentu przeznaczonego do podpisania przez kierownictwo. Celem jest autentyczne współtworzenie zasad, w które twój zespół wierzy, ponieważ pomógł je ukształtować.

Jeśli podczas pierwszej sesji pojawi się prawdziwa różnica zdań, będzie to cecha, a nie błąd. Tego rodzaju napięcia są informacją. Mogą wskazywać, że przed przyjęciem danej zasady należy przeprowadzić więcej rozmów, albo że daną zasadę należy zdefiniować ostrożniej, aby uwzględnić różne perspektywy.

Proces tworzenia zasad jest równie ważny jak same zasady.

Pamiętaj, aby kontynuować przechodząc do Części 3: Zastosowanie w praktyce, w której dowiesz się jak określić zasady AI o najwiekszym znaczeniu dla twojej OSO.

Twoja opinia ma znaczenie

Formularz wkrótce

Niniejszy artykuł to druga część serii "Mapa drogowa odpowiedzialnej AI dla OSO" opracowanej przy okazji projektu AI for Social Change realizowanego przez TechSoup w ramach programu aktywizmu cyfrowego przy wsparciu Google.org.

O autorce

Ayşegül Güzel jest architektką odpowiedzialnego zarządzania AI, która pomaga organizacjom przekształcić obawy związane z AI w godne zaufania systemy. Jej kariera łączy społeczne przywództwo na szczeblu kierowniczym, w tym założenie Zumbara, największej na świecie sieci banków czasu, z techniczną praktyką AI jako certyfikowana audytorka AI i była badaczka danych. Przeprowadza organizacje przez kompletne transformacje w zakresie zarządzania AI i przeprowadza techniczne audyty AI. Prowadzi wykłady w ELISAVA i wygłasza międzynarodowe przemówienia na temat podejścia do technologii zorientowanego na człowieka. Dowiedz się więcej na stronie https://aysegulguzel.info lub zapisz się do jej newslettera „AI of Your Choice” na stronie https://aysegulguzel.substack.com.