Jest to pierwsza część przewodnika "Mapa drogowa odpowiedzialnego AI dla NGOsów". Aby zobaczyć wprowadzenie, kliknij tutaj.

Co jest produktem fazy PATRZ:

Ujawnienie napięć (poprzez wywiady lub przemyślenia)

Wstępna rejestr AI (wykorzystywane narzędzia, dane, których one dotyczą, istniejące obawy).

Zestawienie obecnej wiedzy (obowiązujące przepisy, wartości wyznawane przez twoją organizację, wzorce z danej dziedziny).

Wszystko to będzie surowcem dla fazy TWÓRZ.

1.1 Zacznij od napięć

Najlepszym punktem wyjścia jest uznanie istnienia złożoności, którą twój zespół już odczuwa. Sztuczna inteligencja (AI) istnieje w przestrzeni twórczego napięcia - wydajność czy autentyczność, innowacyjność czy bezpieczeństwo, dostępność czy prywatność. Napięcia te nie są problemami do rozwiązania. Stanowią one drzwi do twoich wartości.

Dwa podejścia:

Opcja A: Rozmowy przed sesją

Jedna osoba przeprowadza krótkie wywiady z członkami zespołu przed rozpoczęciem sesji grupowej. Zadaj każdemu 5 pytań, postaraj się wyłapać schematy, przedstaw grupie zsyntetyzowane spostrzeżenia podczas sesji TWÓRZ. Chodzi tu o głębokie uważne wsłuchanie się przed przejściem do wspólnego tworzenia. Podejście to sprawdza się, gdy:

Chcesz ujawnić szczere obawy, którymi ludzie niekonieczną mogą chcieć podzielić się w grupie

Masz różne zainteresowane strony posiadające różne perspektywy

Chcesz, aby sesja TWÓRZ koncentrowała się na syntezie, a nie na wstępnym odkrywaniu

Opcja B: Na żywo podczas sesji

Zbierz zespół i podczas sesji TWÓRZ wspólnie opracujcie 5 pytań. Daj czas na indywidualne przemyślenia zanim przejdziesz do dyskusji w grupie. Sprawdza się to w przypadku mniejszych zespołów lub gdy budowanie wspólnego zrozumienia jest równie ważne jak sama treść. Podejście to sprawdza się, gdy:

Twój zespół jest mały i ma poczucie bezpieczeństwa psychicznego

Wspólne odkrywanie jest częścią celu

Czas na prace przygotowawcze jest ograniczony

5 pytań:

Niezależnie od tego, czy pytania zostały zebrane wcześniej, czy też zostały przeanalizowane na żywo, stanowią one surowiec dla twoich zasad:

1. Nasz związek z AI

Jakie emocje towarzyszą nam jako zespołowi, gdy myślimy o sztucznej inteligencji?

Nie pomijaj tego kroku. Czy ludzie są podekscytowani? Zaniepokojeni? Ciekawi? Przytłoczeni? Sceptyczni? Nazwij te uczucia. Zapisz je. Niech będą złożone i sprzeczne. To nie jest terapia, to kontekst. Nie można prowadzić sensownej rozmowy na temat zasad, jeżeli nie rozumiesz emocjonalnego krajobrazu, w którym działasz.

2. Nasze nadzieje

Jaki jest najbardziej pozytywny rezultat, który mamy nadzieję osiągnąć dzięki sztucznej inteligencji?

Co staje się możliwe, a nie było możliwe wcześniej? Jakie problemy moglibyśmy rozwiązać? Co moglibyśmy zrobić lepiej, szybciej lub z większym zasięgiem? W tym miejscu pozwól zespołowi rozmarzyć się. Działa to jak "Gwiazda Polarna", przyciągająca ludzi do tego, co chcesz zbudować.

3. Nasze obawy

Jakiej szkodzie najbardziej chcemy zapobiec?

Jak by to wyglądało, gdyby wszystko poszło nie tak? Jaki wynik sprawiłby, że powiedziałbyś: "Nigdy nie powinniśmy byli tego robić"? Jaka jest twoja czerwona linia, granica, której absolutnie nie przekroczysz? Czy możesz opisać konkretne zastosowanie sztucznej inteligencji, które wydawałoby się zasadniczo niewłaściwe dla organizacji takiej jak nasza, nawet jeżeli byłoby technicznie skuteczne? Co spowodowałoby przekroczenie granicy etycznej?

Jest to moc "zabezpieczenia", czyli rozpoznanie tego, przed czym należy się chronić.

4. Nasze wartości niepodlegające negocjacjom

Patrząc na nasze istniejące wartości organizacyjne, która z nich jest najważniejsza do utrzymania podczas wdrażania AI?

Większość organizacji ma już określone wartości. Które z nich są najbardziej zagrożone w kontekście sztucznej inteligencji? Która z nich musi być wartością przewodnią?

Która część twojej pracy powinna zawsze pozostać w pełni ludzka, gdzie pomoc sztucznej inteligencji raczej umniejszyłaby niż polepszyła to, co robisz? Co powinno być zabezpieczone przed automatyzacją?

Oto co łączy zasady sztucznej inteligencji z tożsamością twojej organizacji.

5. Nasza Gwiazda Polarna

Gdybyśmy mogli wybrać tylko 3-5 zasad kierujących naszą pracą nad AI, jaki by to były zasady i dlaczego akurat te?

Zasiej to ziarno wcześnie. Powrócisz do niego z większą ilością informacji w fazie TWÓRZ.

Co należy uchwycić:

Dokumentuj wszystko: konkretne napięcia wymieniane przez członków zespołu, obawy, nadzieje, wzorce. Powtarzające się zwroty lub słowa, np. "autentyczność" lub "zaufanie społeczności", sygnalizują twoje zasady.

1.2 Rozpoczęcie pracy nad rejestrem AI

Kiedy to zrobić: W miarę możliwości przed sesją grupową. Jedna osoba lub mała grupa może sporządzić wstępny rejestr, a następnie go zweryfikować i rozszerzyć z udziałem całego zespołu podczas sesji TWÓRZ.

→ Użyj arkusza rejestru AI znajdującego się w Zidentyfikuj | Arkusz roboczy definiowania zasad AI , aby wychwycić narzędzia i obawy związane ze sztuczną inteligencją występujące w twojej organizacji.

Dlaczego ma to znaczenie:

Rozmowa staje się konkretna (zamiast mówienia o abstrakcyjnych zasadach, stwierdzamy: "używamy tych narzędzi").

Napięcia zostają ujawnione w sposób organiczny (inwentaryzacja pojawia się tam, gdzie organizacja czuje się niepewnie).

Dostarczony zostaje surowiec do identyfikacji zasad (narzędzia i związane z nimi ryzyko informują, które zasady są najważniejsze).

Odkryta zostaje "szara AI" - narzędzia, których członkowie zespołu używają nieformalnie, bez zgody organizacji.

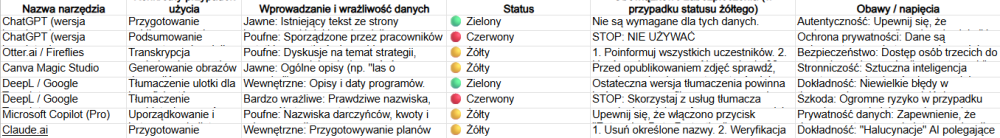

Struktura rejestru:

Rysunek 1: Zawartość tej tabeli jest przykładowa, można ją znaleźć wraz z edytowalną tabelą tutaj

Ważne: Narzędzie AI nie posiada stałego statusu. Status to wypadkowa narzędzia, przypadku użycia i wrażliwości danych. Zawsze oceniaj konkretne zadanie przed jego rozpoczęciem.

Kategorie statusu:

🟢 Zielony: Dozwolone

🟡 Żółty: Zachować ostrożność. Użycie dozwolone, ALE tylko przy zastosowaniu określonych zabezpieczeń.

🔴 Czerwony: Użycie zabronione. Nie używać.

⚪ Szary: Lista życzeń / Faza rozpoznawcza.

Poziomy wrażliwości danych:

Jawne: Brak obaw związanych z ujawnieniem

Wewnętrzne: Wyłącznie do użytku organizacyjnego

Poufne: Ograniczony dostęp, poufne informacje organizacyjne

Bardzo wrażliwe: Dane osobowe, informacje o beneficjentach lub treści prawnie chronione.

Wskazówka ułatwiająca: Podczas gromadzenia informacji do rejestru należy zapewnić bezpieczne warunki dla uczciwego ujawniania informacji. Ludzie często używają narzędzi AI, o których wcześniej nie wspominali, ponieważ nie są pewni, czy jest to "dozwolone". Mechanizmy anonimowego dostarczania informacji mogą pomóc w ujawnieniu szarej strefy wykorzystywania AI.

Niech rejestr będzie żywym dokumentem. Będzie stawał się coraz bardziej szczegółowy w miarę opracowywania struktur i polityk zarządzania w fazie TWÓRZ.

→ Karta rejestru AI znajdująca w arkuszu roboczym ma być aktualizowana w miarę upływu czasu. Zacznij w prosty sposób i dodawaj kolejne szczegóły w miarę pogłębiania swojej wiedzy.

1.3 Zgromadzenie istniejącej wiedzy

Kiedy to zrobić: Przed sesją grupową. Jedna osoba może zebrać te informacje i przedstawić je podczas spotkania w sesji TWÓRZ, co zagwarantuje, że zespół będzie miał wspólne podstawy do pracy.

Co zebrać:

Wartości i zasady istniejące w twojej organizacji

Deklaracja misji, plan strategiczny, kodeks etyczny

Wszelkie istniejące technologie lub polityki dotyczące danych

Deklaracje wartości pochodzące z dokumentów założycielskich

Zobowiązania podjęte wobec fundatorów, partnerów lub społeczności

Zapytaj: W jaki sposób te istniejące wartości mogą mieć zastosowanie do AI?

Twoje otoczenie regulacyjne

Jakie przepisy mają zastosowanie w twoim kontekście? (Unijny Akt w sprawie AI, RODO, wymogi sektorowe)

Czego oczekują fundatorzy w zakresie wykorzystania AI lub ochrony danych?

Czego oczekuje twoja społeczność?

Czy w twojej branży obowiązują standardy zawodowe?

W odniesieniu do organizacji społeczeństwa obywatelskiego, kluczowe zasady Unijnego Aktu w sprawie sztucznej inteligencji obejmują nadzór ze strony człowieka, przejrzystość, jakość danych i niedyskryminację. Ramy te stanowią przydatny punkt odniesienia nawet poza UE.

→ Zobacz Unijny Akt w sprawie AI oraz dopasowanie zasad (arkusz Najczęstsze zasady odpowiedzialnej AI) w arkuszu roboczym do pobrania (Zidentyfikuj | Arkusz roboczy definiowania zasad AI), aby zrozumieć, które zasady mają wsparcie regulacyjne.

Wzorce z danej dziedziny

Społeczność globalna opracowuje zasady odpowiedzialnej sztucznej inteligencji od 2019 r. Nie musisz badać tego wszystkiego samodzielnie. Zebraliśmy dla ciebie najistotniejsze ramy i przykłady.

→ Zobacz Wzorce zasad odpowiedzialnego AI , aby zapoznać się z przykładami organizacji realizujących misję, np. Khan Academy, ChangemakerXchange, Common Sense Media i in.

→ Zobacz Najczęstsze zasady odpowiedzialnego AI w arkuszu roboczym do pobrania (Zidentyfikuj | Arkusz roboczy definiowania zasad AI) , w którym zawarto definicje zasad najczęściej cytowanych w UE, OECD, UNESCO i NIST.

Rezultat:

Kompilacja lub krótka prezentacja, która wnosi tę wiedzę do sesji TWÓRZ:

Zestawienie przepisów istotnych w twoim kontekście

Wartości istniejące w twojej organizacji (z uwagami na temat istotności AI)

Arkusz referencyjny wspólnych zasad (udostępniony)

1-2 przykłady z podobnych organizacji, które współgrają z twoją misją

Celem nie jest to, by zostać ekspertem w każdej dziedzinie. Chodzi o to, żeby posiadać wystarczający kontekst, aby zespół mógł dokonywać świadomych wyborów dotyczących tego, które zasady mają największe znaczenie dla twojej organizacji. Ciężką pracę wykonają dostarczone przez nas materiały. Twoim zadaniem jest wniesienie unikalnej perspektywy twojej organizacji.

Kontynuuj pracę z naszym przewodnikiem przechodząc do Części 2: TWÓRZ - Zidentyfikowanie i zdefiniowanie zasad, aby dowiedzieć się, jak zidentyfikować zasady AI, które mają największe znaczenie dla twojego NGO, oraz Części 3: Zastosowanie w praktyce, w której dowiesz się jak zidentyfikować zasady AI o największym znaczeniu dla twojej organizacji.

Twoja opinia ma znaczenie

Co sądzisz o tym tekście? Poświęć 30 sekund, aby podzielić się swoją opinią i pomóc nam tworzyć wartościowe treści dla społeczeństwa obywatelskiego!

Niniejszy artykuł rozpoczyna serię "Mapa drogowa odpowiedzialnej AI dla OSO" opracowanej przy okazji projektu AI for Social Change realizowanego przez TechSoup w ramach Programu Aktywizmu Cyfrowego przy wsparciu Google.org.

O autorce

Ayşegül Güzel jest architektką odpowiedzialnego zarządzania AI, która pomaga organizacjom przekształcić obawy związane z AI w godne zaufania systemy. Jej kariera łączy społeczne przywództwo na szczeblu kierowniczym, w tym założenie Zumbara, największej na świecie sieci banków czasu, z techniczną praktyką AI jako certyfikowana audytorka AI i była badaczka danych. Przeprowadza organizacje przez kompletne transformacje w zakresie zarządzania AI i przeprowadza techniczne audyty AI. Prowadzi wykłady w ELISAVA i wygłasza międzynarodowe przemówienia na temat podejścia do technologii zorientowanego na człowieka. Dowiedz się więcej na stronie https://aysegulguzel.info lub zapisz się do jej newslettera „AI of Your Choice” na stronie https://aysegulguzel.substack.com